- · 探索与争鸣版面费是多少[06/30]

- · 《探索与争鸣》投稿方式[06/30]

- · 《探索与争鸣》期刊栏目[06/30]

Facebook探索利用深度学习带来灵巧细微的手部交互

作者:网站采编关键词:

摘要:查看引用/信息源请点击:映维网 由爱丁堡大学、香港大学和Facebook?Reality Labs组成的团队 (映维网?2021年07月06日)据统计,人类平均每天与140个对象交互。在不同的文化和地理环境中,

查看引用/信息源请点击:映维网

由爱丁堡大学、香港大学和Facebook?Reality Labs组成的团队

(映维网?2021年07月06日)据统计,人类平均每天与140个对象交互。在不同的文化和地理环境中,我们交互的日常用品的形状和形式非常不同。迄今为止,行业尚未出现能够与人手灵巧程度相媲美的智能代理。在动画和游戏中,手指运动涉及繁琐的手部动画制作或动捕数据清理,尤其是涉及对象交互的数据。

对于虚拟现实或增强现实,基于控制器或基于手指捏合的对象交互模型无法产生真实的和微妙的手指运动,并会打破沉浸感。利用深度强化学习的最新进展,机器手可以学习精确地执行专门的任务,例如求解魔方等等。然而,一个能够就各式各样对象执行一系列操作任务的通用模型依然遥不可及,更不用说优雅且自然地执行。

由爱丁堡大学、香港大学和Facebook Reality Labs组成的团队利用了行业在深度学习方面的成功,尝试通过深度神经网络直接从数据中学习自然操作行为。然而,操纵的组合性质加剧了对高质量数据的要求。操作不仅取决于对象的形状、大小和功能,同时取决于预期任务、手部解剖结构,甚至个人喜好。尽管现在可以实时捕捉手物交互,但巨大的情景可变性令人望而生畏。

由爱丁堡大学、香港大学和Facebook Reality Labs组成的团队利用了行业在深度学习方面的成功,尝试通过深度神经网络直接从数据中学习自然操作行为。然而,操纵的组合性质加剧了对高质量数据的要求。操作不仅取决于对象的形状、大小和功能,同时取决于预期任务、手部解剖结构,甚至个人喜好。尽管现在可以实时捕捉手物交互,但巨大的情景可变性令人望而生畏。

针对这种情况,有研究人员致力于提高社区数据集的质量和数量,而爱丁堡大学、香港大学和Facebook Reality Labs则尝试研究是否能够将基于小量对象形状的学习类推到几何变化情景,并将目标驱动的抓取扩展到人类经常自然和无意地执行的微妙手指姿态和手部操作。日前,团队发表了一篇名为《ManipNet: Neural Manipulation Synthesis with a Hand-Object Spatial Representation》的相关论文。

爱丁堡大学、香港大学和Facebook Reality Labs的中心思想是利用代表手部和对象空间关系的特征,并结合有关抓取的生物力学文献。早前的研究指出,总体的抓取姿势位于低维空间中,而这在很大程度上取决于任务。手部姿态的高阶变化取决于对象形状的细节。另外,随着手部越来越靠近对象,手部姿态的变化将会开始形成。所以,研究人员为全局对象形状选择一个粗略表示,但仅当手部接近时为对象表面的局部几何细节选择一个密集表示。

业界存在一系列用于表示神经网络三维几何的解决方案,如体素占用网格,符号距离场和点样本。在爱丁堡大学、香港大学和Facebook Reality Labs的例子中,研究人员尝试减少特征维数以避免过度拟合,同时依然捕获重要信息。团队使用低分辨率的体素占用网格来表示对象的形状,并发现手部和对象表面之间的距离采样是有效的低维信号,能够很好地捕获细节。

对于《ManipNet: Neural Manipulation Synthesis with a Hand-Object Spatial Representation》的研究, 爱丁堡大学、香港大学和Facebook Reality Labs的团队训练一个能够根据控制信号和对象几何特征来预测操作对象时的手指姿势的神经网络。控制信号是手腕和对象的6D轨迹。

早前的研究已经证明了所述控制信号在限制手指操作运动方面的有效性。然而,一个深入的学习公式同时需要一个最小和明确的输入表示。

研究人员设计的网络只处理一个手部-对象。团队镜像另一只手,运行网络两次,从而为两只手生成预测。这种设计允许研究人员在手部空间中变换输入特征,以消除世界坐标的模糊性,并允许其能够在一个统一的框架中处理交互手部和对象的不同组合。

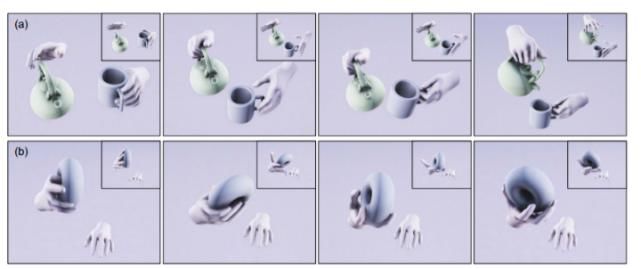

研究人员提出的系统无需详尽的数据集即可成功地合成各种手指姿态,可用于协调双手任务或针对不同对象集进行手部操作,例如端茶或在转动大圆环。团队同时演示了它在游戏和AR/VR中的实时交互潜力。团队表示,将公布在这项研究的操作数据集,以支持精细手指姿态的研究。

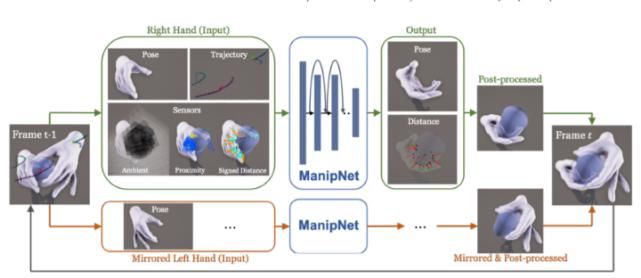

研究人员提出的系统概述如图2所示。它将手腕和操纵对象的轨迹,以及手的蒙皮网格和对象的三维几何图形作为输入。然后,系统使用深度神经网络ManipNet作为自回归模型,逐帧生成双手的详细手指姿势。尽管网络本身只考虑一只手,但系统能够在统一的框架中处理手和对象的不同组合。

研究人员提出的系统概述如图2所示。它将手腕和操纵对象的轨迹,以及手的蒙皮网格和对象的三维几何图形作为输入。然后,系统使用深度神经网络ManipNet作为自回归模型,逐帧生成双手的详细手指姿势。尽管网络本身只考虑一只手,但系统能够在统一的框架中处理手和对象的不同组合。

为了提高网络的通用性和避免对训练数据的过度拟合,团队提出了三种虚拟传感器来编码对象的几何结构及其与手的空间关系。所述传感器以粗体素网格的形式捕捉全局对象形状,以点样形式捕捉局部几何细节。全局特征有助于规划整体姿态和预测未来运动,而局部特征在实现对几何变化的泛化方面起着重要作用。ManipNet是一种基于剩余稠密网络结构的时间序列模型。网络的输入包括前一帧中的手姿势、传感器特征和控制信号,其中包括手腕和围绕前一帧对象的过去和未来轨迹。

文章来源:《探索与争鸣》 网址: http://www.tsyzmgw.cn/zonghexinwen/2021/0707/353.html